Actualmente existe una discusión académica y política sobre cómo combatir las noticias falsas y sus efectos sobre la población, principalmente del chequeo de noticias falsas. Existen muchas posturas al respecto, pero hay dos mayoritarias opuestas: una que sostiene la necesidad de desmentir las noticias falsas, y otra que sostiene que al ofrecer una corrección de los datos falsos se profundizan las creencias falsas, generando un efecto rebote o efecto contraproducente. Aunque las conclusiones de especialistas señalan que ese ‘efecto rebote’ no puede comprobarse, Facebook insiste en aplicar una censura sobre contenidos chequeados y científicos. ¿Por qué? Ethan Porter y Thomas J. Wood, reflexionan en esta nota.

La red antisocial más grande del mundo tiene una idea equivocada sobre cómo luchar contra las conspiraciones de Covid-19

La semana pasada apareció en Facebook un video con falsedades sobre Covid-19, fue visto varios millones de veces. La compañía tomó medidas para minimizar el alcance del video, pero sus verificaciones de hechos, en particular, parecen haberse aplicado con una reticencia curiosa, si no peligrosa. La razón de esa reticencia debería alarmarte: parece que la red social más grande del mundo está, al menos en parte, basando su respuesta a la información errónea relacionada con la pandemia en una lectura errónea de la investigación académica. (N. de la E: en Argentina esta maniobra ya tiene sus víctimas: puede verse claramente en la censura a Factorelblog.com, de Alejandro Agostinelli, un conocido sitio Anti Fake News).

Lo que está en juego es la antigua deferencia de la compañía al riesgo de los llamados “efectos contraproducentes”. Es decir, a Facebook le preocupa que el simple hecho de tratar de desacreditar una afirmación falsa solo pueda ayudar a fortalecer la mentira. La CEO y fundadora Mark Zuckerberg expresó esta preocupación precisa en febrero de 2017: “La investigación muestra que algunas de las ideas más obvias, como mostrar a las personas un artículo desde la perspectiva opuesta, en realidad profundizan la polarización“, dijo. Más tarde, la compañía citaría la misma teoría para explicar por qué había dejado de aplicar advertencias de “bandera roja” a titulares falaces: “La investigación académica sobre la corrección de la información errónea”, escribió una gerente de productos de Facebook, ha demostrado que tales advertencias “pueden afianzar creencias profundamente arraigadas“, algo que la empresa tiene claro con Cambridge Analytica y los gobiernos de EEUU, India, Brasil y el macriato de Argentina.

El miedo de Facebook a un efecto rebote no ha disminuido en medio de esta pandemia, o la infodemia que vino con ella. El 16 de abril, la compañía anunció un plan para lidiar con la desinformación desenfrenada de Covid-19: además de poner etiquetas de advertencia en algún contenido específico, mostraría advertencias absolutamente ambiguas a aquellas personas que habían interactuado con una información falsa y las empujaría hacia fuentes “autorizadas”. La imprecisión de estas últimas advertencias, dijo Facebook al sitio web STAT, tenía el objetivo de minimizar el riesgo del efecto rebote.

Pero aquí está la cosa: lo que sea que Facebook diga (o piense) sobre el efecto rebote, se trata de un fenómeno que no se ha “mostrado” o demostrado de manera exhaustiva. Más bien, es una suerte de “cuco”, una teoría zombie del mundillo académico, acuñada alrededor de 2008, que fue abandonada ese mismo año. Estudios más recientes, que abarcan una amplia gama de temas, concluyeron que lo que sucede es lo contrario a eso: en casi todos los temas posibles, casi siempre, la persona promedio, derechosa o progre, joven o vieja, bien educada o no, responde a los hechos como es esperable, chequeándolos.

Sí, es posible encontrar excepciones. Si repasás toda la investigación cuidadosamente, te vas a topar con las raras ocasiones en que, en entornos experimentales, las correcciones han fallado. Sin embargo, si necesitás una regla general, planteate esto: las desacreditaciones y las correcciones son efectivas, punto final. Algo que acerca mucho más al consenso académico que la sugerencia de que los efectos negativos son generalizados y representan una amenaza activa para el diálogo social en línea.

Esos artículos de Snopes.com, publicaciones de Politifact y verificaciones de hechos de CNN que has leído a lo largo de los años, hicieron su trabajo. Según el recuento, a través de experimentos con más de 10,000 personas, las verificaciones de hechos aumentan la proporción de respuestas correctas en las pruebas de seguimiento en más de 28%. Pero no sólo eso: otras investigadoras han llegado a conclusiones muy similares. Si existen efectos contraproducentes del chequeo de noticias, son difíciles de encontrar. La negación, frente a una nueva información que corrige o desmiente una información errónea, ciertamente no es una tendencia humana general, ni siquiera cuando a las personas se les presentan hechos correctivos que atentan contra sus compromisos políticos más profundos.

Sin duda, la bibliografía académica ha evolucionado. Cuando comenzamos esta investigación en 2015, el concepto de efecto rebote era ampliamente aceptado. No hay al respecto publicación más clara que el influyente Manual de desacreditación, publicado por primera vez en 2011 por las psicólogas John Cook y Stephan Lewandowsky. Una antología de la mejor investigación contemporánea, en gran parte realizada por las autoras pero también por sus colegas, el Manual detalla numerosos riesgos del efecto rebote. “A menos que se tenga mucho cuidado”, advirtieron las autoras, “cualquier esfuerzo para desacreditar la información errónea puede reforzar inadvertidamente los mitos que uno trata de corregir”.

Luego, hace dos meses, Cook y Lewandowsky siguieron con The Conspiracy Theory Handbook (podés descargarlo en ese enlace). Según la lógica de la hipótesis del rebote, las teorías de conspiración deberían estar entre las tonterías más obstinadas, las más impermeables a la verificación de hechos. Están respaldadas por usuarias casuales simples, y apelan a nuestras identidades sociales. Pero las autoras alentaron a las lectoras a aplicar “desacreditaciones basadas en hechos”, bajo la premisa de que proporcionar información objetiva reduce la creencia en conspiraciones; o bien “desacreditaciones basadas en la lógica” que alientan a las personas a considerar los fundamentos inverosímiles de sus teorías. Cook y Lewandowsky se han vuelto menos cautelosas, en cierto modo, con respecto a la información errónea: si alguna vez se preocuparon por provocar un rebote, ahora sugieren usar hechos para refutar la información errónea más espinosa. Para su enorme crédito, estas autoras han actualizado sus guías ampliamente leídas para que coincidan mejor con la evidencia más reciente (incluida la ofrecida por su propia investigación).

Entonces, ¿por qué una empresa de redes sociales como Facebook permanecería tercamente unida a la teoría del efecto rebote? Es posible que la compañía tenga evidencia de que nosotras y nuestras colegas no hemos visto. Facebook rara vez permite que investigadoras externas administren experimentos en su plataforma y publiquen los resultados. Puede ser que los mejores diseños experimentales para estudiar las verificaciones de hechos simplemente no capturan la experiencia real de interactuar en la plataforma de un día para otro. Quizás las usuarias de Facebook del mundo real se comporten de manera diferente a las de nuestros estudios. Tal vez pasen por alto las verificaciones de datos o se acostumbren cada vez más a ellos con el tiempo. Si ese es el caso, Facebook puede haber documentado evidencia clara de rebote en la plataforma, y nunca la ha compartido.

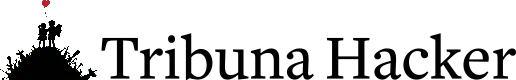

Dicho esto, acabamos de terminar un conjunto de experimentos nuevos y más realistas que indican fuertemente que las verificaciones de hechos funcionarían en Facebook, sin causar ningún efecto negativo. Debido a que no pudimos ejecutar nuestro estudio en la plataforma en sí, hicimos lo siguiente: usamos una réplica del sitio web. Trabajando con asistencia de ingeniería (pero sin financiamiento directo) de Avaaz -un grupo activista internacional- establecimos estudios en un sitio meticulosamente diseñado para parecerse a las noticias de Facebook. Las imágenes a continuación muestran lo que encontraron las participantes de nuestro estudio. Como se puede ver, cada fuente de noticias contenía una serie de historias: algunas falsas, algunas con correcciones de hechos y otras con contenido que no tenía nada que ver con noticias falsas o correcciones de hechos. (Llamamos a esta categoría final “contenido de placebo”).

7,000 personas fueron reclutadas a través de YouGov para ver diferentes cantidades de noticias falsas, luego las noticias corregidas y contenido de placebo. Al medir luego sus creencias sobre las noticias falsas, pudimos evaluar los efectos de las correcciones. Les mostramos a las participantes cinco historias falsas en total, cada una extraída de las redes sociales en los últimos años. Primero, en una fuente de noticias, presentamos al azar una variedad de historias falsas, alegando, entre otras cosas, que las inmigrantes ilegales habían contribuido a un brote de sarampión en los Estados Unidos; que Donald Trump había llamado “las votantes más tontas” a las republicanas; y que las torres 5G emiten radiaciones nocivas. Luego, en una segunda fuente de noticias, asignamos aleatoriamente a personas para ver (o no ver) verificaciones de hechos de la información errónea presentada anteriormente. (Nadie vio verificaciones de hechos sobre noticias que no habían visto). Finalmente, les preguntamos a todas si creían en la información errónea a la que fueron expuestas.

Los resultados no fueron diferentes de lo que habíamos encontrado en trabajos anteriores. En todos las temáticas, las personas que habían visto información errónea y luego una verificación de los hechos relacionados eran sustancialmente más precisas desde el punto de vista fáctico que las personas que sólo habían visto la información errónea. Acordate de que el efecto rebote sostiene que estar expuesta a una corrección, haría que todo fuera menos preciso. Pero la persona promedio no respondió de esa manera. De hecho, todo tipo de personas se benefició de las verificaciones de hechos. Investigaciones anteriores han encontrado que, en las redes antisociales, las noticias falsas son compartidas desproporcionadamente por las mayores y más conservadoras. En nuestro estudio, este grupo no mostró ninguna vulnerabilidad especial a los efectos rebote. Cuando se presentaron verificaciones de hechos, también retuvieron información más precisa.

Realizamos dos experimentos en esta plataforma, metiendo pequeños cambios en el diseño de las verificaciones de datos y en la forma en que medimos las respuestas de las personas. Estos cambios no hicieron mella en nuestras conclusiones. Las verificaciones de hechos condujeron a grandes aumentos de precisión en ambos experimentos: por cada noticia falsa sin corrección, solo el 38 por ciento de las respuestas identificaron correctamente la historia como falsa. Después de una sola corrección, el 61 por ciento de las respuestas fueron precisas.

¿Qué pasa con la posibilidad de que los efectos rebote generen una fatiga del chequeo? Quizás, después de ver muchas correcciones, la gente baja la guardia. Nuestro diseño experimental nos permitió investigar esta posibilidad, y descubrimos que no pasaba. A medida que aumentó el número de correcciones que las personas vieron, las mejoras en la precisión de los hechos se mantuvieron consistentes. Podés leer nuestro documento de preimpresión completo aquí. https://osf.io/r3mvw

En medio de la pandemia actual, el acceso a información objetivamente precisa es más importante que nunca. Afortunadamente, la investigación académica es clara. Las verificaciones de hechos funcionan. La gente no es contraproducente. Las empresas de redes sociales deben comportarse en consecuencia.

Vía Wired